1. Meta 가 요즘 일을 잘 하고 있습니다. 지난번엔 LLaMA 모델을 슬쩍 보여주더니,

2. 이번엔 이미지 속에서 어떤 사물이든 분리해준다는 SAM(Segment Anything Model)을 공개했습니다. AI 시대에 로봇의 눈 같이 쓸 수 있는 코어 엔진입니다. 아래와 같은 해상도의 이미지 장수와 마스크를 학습했다고 합니다.

Dataset Characteristics

Total number of images: 11M

Total number of masks: 1.1B

Average masks per image: 100

Average image resolution: 1500×2250 pixels

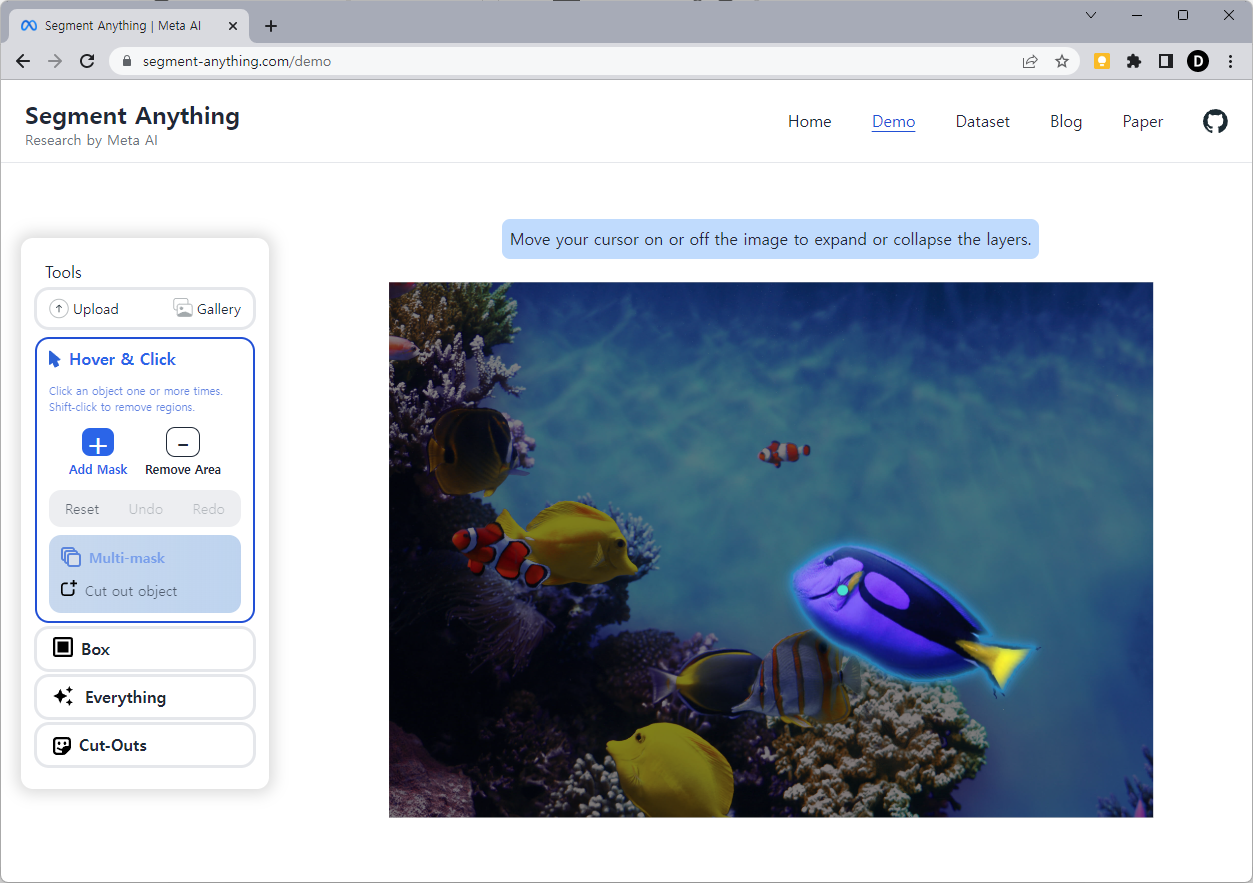

3. Meta의 Segment Anything 사이트에 접속 후 Demo 페이지를 클릭하면 내 이미지를 업로드하여 세그먼트 기능을 사용해 볼 수 있습니다. Waitlist 나 Request early access 기다릴 필요 없이 바로 사용 Demo 가능합니다! 근데 API 로 제공하기 전까지는 정작 사용 할 곳은 배경제거 정도 밖에 없다는.

> https://segment-anything.com

4. Segment 는 물체 인식에 있어서 상당히 중요한 기반 기술입니다. 테슬라 자율주행 자동차가 자동차 앞에 놓인 것이 무엇인지 구분 하는데도 쓰이고 있고, LiDAR 센서로 거리 정보를 포인트 클라우드(point cloud)로 획득하더라도 어떤 형상인지 인식하기 위해서는 배경으로부터 분리 해야합니다. 로봇 비전 분야에서의 사물인식, 물류센터에서의 물건 자동 분류작업, AR 글래에서에 사물인식 및 안내 등 너무나도 많은 분야에 기반 기술로 쓰일 수 있습니다.

5. 참고로 Tesla Autopilot Vision 화면입니다. 2020년도 쯤 나왔던 화면이니 지금은 훨씬 더 많이 발전 했을 겁니다.

6. 오 검출률이 높은 분야기 때문에 섣불리 공개하기가 어려운데, 이렇게 공개를 했다는 것은 그동안 수많은 검증을 했고 이제 어느정도 자신이 있다는 신호로 보입니다.

댓1. 10여년전 라떼시절 이거 구현해 보겠다고 OpenCV 로 Random forest 구현하고 RANSAC 구현하고 튀는 픽셀 노이즈 잡아보겠다고 FFT 등 고생하던 것을 생각하면.. 정말 이건 신세계입니다!

댓2. 당시엔 학습 데이터를 만드느라 인력을 써야만 했고 세그먼트 + Ground truth 레이블링 하는데 장당 얼마라고 했었는데 세월이.. 쿨럭!

'GenAI' 카테고리의 다른 글

| 낙서도 작품으로 스테이블 두들(Stable Doodle) 사용후기 (0) | 2023.07.15 |

|---|---|

| [뉴스] GenAI 테크 트렌드 4월 (0) | 2023.04.24 |

| MS 디자이너(Designer) 베타 테스트 후기 (1) | 2023.03.30 |

| 어도비 파이어플라이(Adobe Firefly) 후기 (0) | 2023.03.30 |

| [BingAI] 빙AI vs 챗GPT vs 노션AI 성능비교, 책 요약을 요청하다 (0) | 2023.02.22 |