Good artists copy, great artists steal.

- Pablo Picasso

시대의 거장이었던 파블로 피카소가 한 말입니다. 애플의 스티브 잡스도 즐겨 인용한 말입니다. 모방은 창조의 어머니라는 말도 있습니다. 그런데 왜 모방보다 훔치는 것을 위대하다 했을까 사유해봅니다. 모방은 단순한 복사(copy)에 불과하다고 본 것 같습니다. 복사는 자료 스크랩입니다. 그런데 훔치다(steal)은 내 것으로 만든다는 의미가 부여됩니다. 이것은 개인의 재해석이 들어가기에 재발명(reinvent)에 가깝습니다. 챗GPT가 내놓은 답변 텍스트도 그대로 복사한다면 그냥 AI가 내놓은 답변에 그치지만 그것을 이해하고 정리하고 재조직해서 인용하면 그것은 내 생각이 되고 내 글이 됩니다.

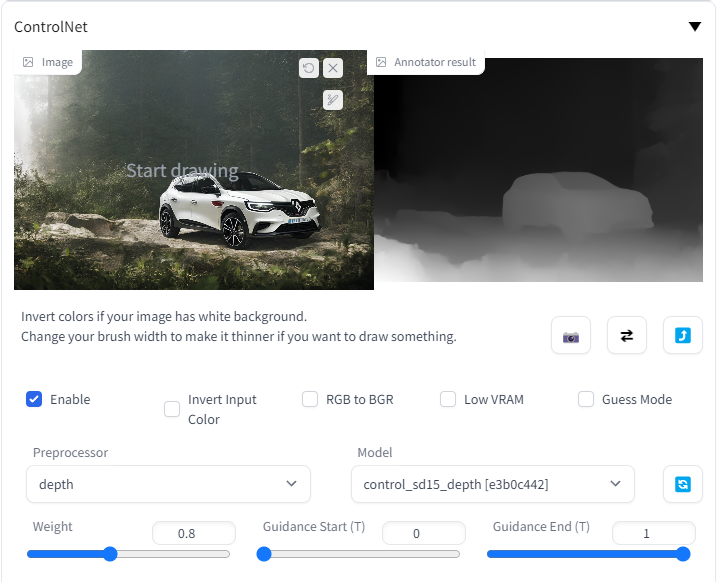

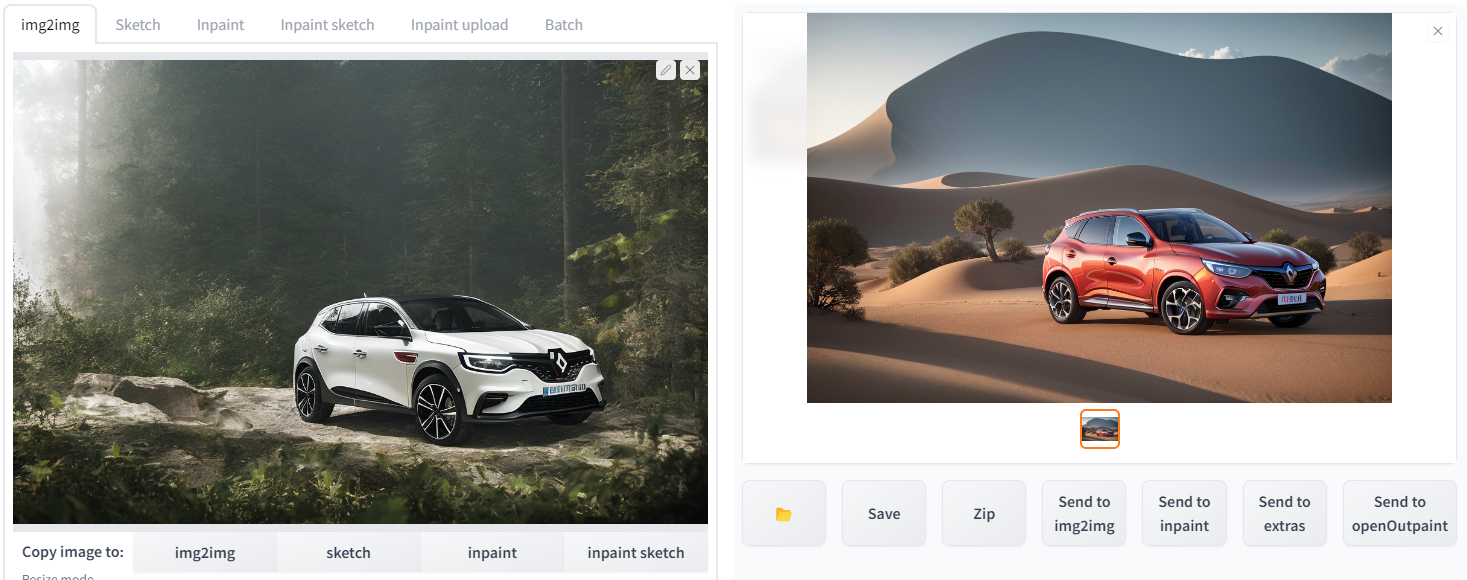

아주 멋진 광고 사진을 보았다고 가정해 보겠습니다. 너무 마음에 들어 이 구도와 위치, 장면의 요소요소를 훔치고 싶을 때, 입력 이미지의 깊이정보(depth)을 추출, 복사하여 AI 이미지에 가이드로 사용합니다. Depth to Image(Depth2Img)라고도 합니다.

- txt2txt : 챗GPT

- txt2img : 미드저니, 스테이블 디퓨전

- img2img : 엔비디아 캔버스, 스테이블 디퓨전

- depth2img: 스테이블 디뷰전(ControlNet)

들어가면 들어갈수록 스테이블 디퓨전에 감탄하고 있습니다. 인공지능 분야에서도 GenAI 라는 새시대를 열어줄 엄청난 힘을 갖고 있는 녀석입니다.

Stable Diffusion의 ControlNet을 이용한 Depth to Image

1. 스테이블 디퓨전을 켜고 [img2img] 로 이동합니다.

2. 모방할 이미지를 Drag & Drop 하여 넣습니다.

3. ControlNet을 켜고, Enable 체크 프리프로세서와 모델을 모두 depth 로 맞춰줍니다.

Preprocessor: depth, Model: control_sd15_depth

4. [Preview annotator result] 버튼을 눌러 depth map 을 확인해 봅니다.

5. Weight 값은 기본 값이 1.0인데 모양이 틀어지거나 변화의 자유도를 좀더 주고 싶을 때 값을 조절해 줍니다.

6. 프롬프트를 입력하고 [Generate] 번튼을 누르면 <끝>

참 쉽죠?

[1] ControlNet 모델 다운받기, https://huggingface.co/lllyasviel/ControlNet/tree/main/models

살짝 바퀴가 틀어진 모습까지 점알 기가막히게 자동차 포즈가 모방된 것을 볼 수 있습니다.

'StableDiffusion' 카테고리의 다른 글

| 무료 AI 이미지 서비스들 5종 비교 (1) | 2023.03.27 |

|---|---|

| [SD] 프롬프트 하나로 15개 스테이블 디퓨전 모델 결과보기 (1) | 2023.03.21 |

| [ControlNet] 틀린 그림 찾기, 아니 만들기 (0) | 2023.03.08 |

| [SD] 스디 선생이 만들어준 베리베리 라떼 (0) | 2023.03.08 |

| AI 이미지 생성시 좋은 프롬프트(prompt) 작성하는 방법 (2) | 2023.02.06 |